梯度消失問題

梯度消失問題

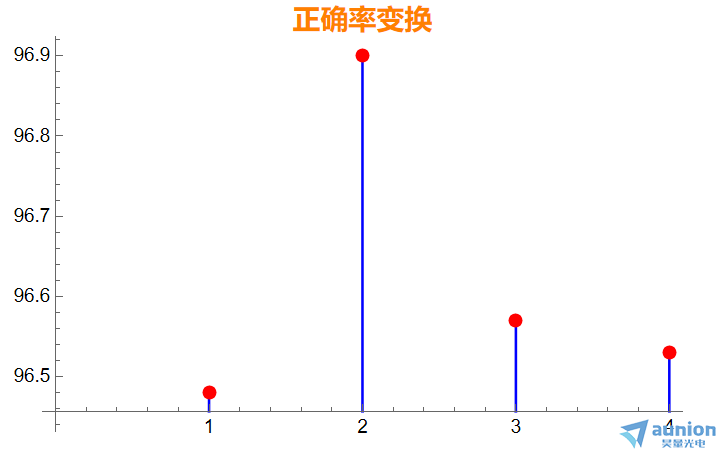

假設輸入層784個(ge) ,輸出參數10個(ge) ,每一個(ge) 隱藏層包含30個(ge) 元素。

1. 當隱藏層為(wei) 一層,正確率為(wei) 96.48%

2. 當隱藏層為(wei) 二層,正確率為(wei) 96.90%

3. 當隱藏層為(wei) 三層,正確率為(wei) 96.57%

4. 當隱藏倉(cang) 為(wei) 四層,正確率為(wei) 96.53%

增加隱藏層,並沒有提高正確率,反而有時會(hui) 減小。

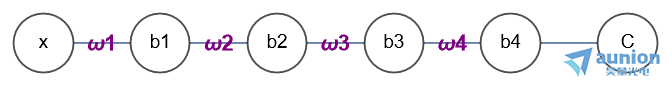

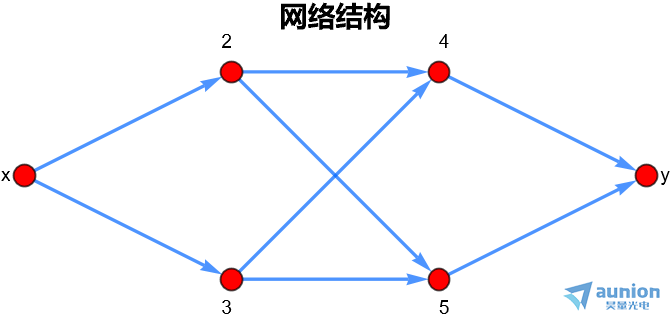

做一個(ge) 簡單的假設,輸入層隻有一個(ge) 參數,包含四個(ge) 隱藏層,輸出也隻有一個(ge) 。

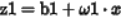

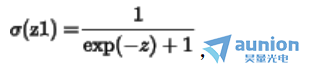

x表示輸入參量, 表示權重(是一個(ge) 向量),b1表示偏置,

表示權重(是一個(ge) 向量),b1表示偏置, 。每個(ge) 隱藏層輸出為(wei)

。每個(ge) 隱藏層輸出為(wei)  ,即每個(ge) 隱藏層的輸出結果,使用a描述,通常用z小二乘的方式描述評價(jia) 函數C,梯度下降的方法不斷修改其中的參數

,即每個(ge) 隱藏層的輸出結果,使用a描述,通常用z小二乘的方式描述評價(jia) 函數C,梯度下降的方法不斷修改其中的參數 和參數b,令評價(jia) 函數C趨向於(yu) Min,此時神經網絡描述的函數既是想輸入函數擬合的過程。

和參數b,令評價(jia) 函數C趨向於(yu) Min,此時神經網絡描述的函數既是想輸入函數擬合的過程。

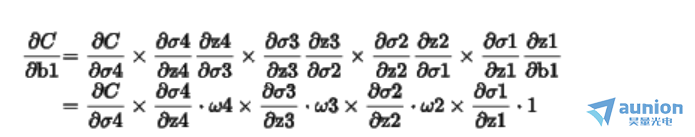

如果此時去求解評價(jia) 函數C對於(yu) 偏置b1的導數,用到導數的鏈式法則。

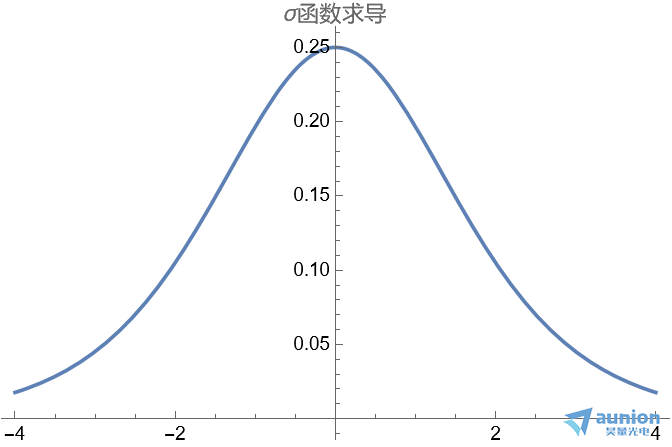

一般 的導數如圖所示

的導數如圖所示

如上圖所示,通常 的導數,Max值為(wei) 0.25。

的導數,Max值為(wei) 0.25。

如果乘以 後模值小於(yu) 1,那麽(me) 原靠近輸入的層的梯度越小,這就是導致梯度消失的原因

後模值小於(yu) 1,那麽(me) 原靠近輸入的層的梯度越小,這就是導致梯度消失的原因

當然也有可能是乘以[MISSING IMAGE: , ]後大於(yu) 1的情況存在,那麽(me) 越靠近輸入層的梯度越來越大,這就是導致梯度爆炸的原因。

當隱藏層數量過多的時候,可能會(hui) 導致梯度消失或者梯度爆炸,zui終令神經網絡變得不穩定。

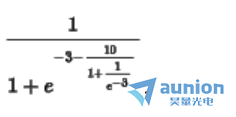

假設需要輸入函數 ,在區間

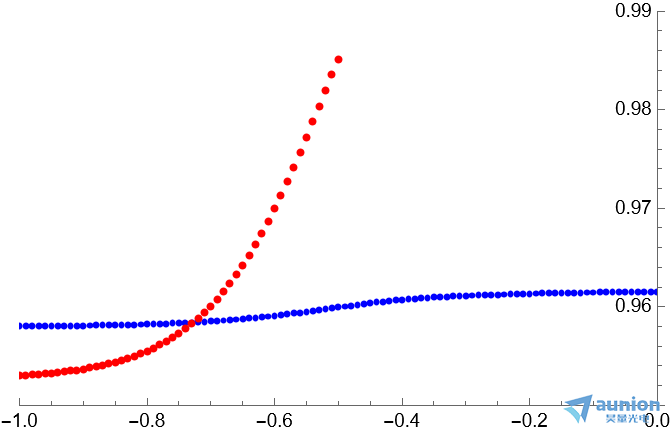

,在區間 之間輸入和輸出如圖所示

之間輸入和輸出如圖所示

此時假設設計一個(ge) 神經網絡,

輸入神經元為(wei) 1個(ge) ,輸入數據為(wei) 其橫坐標;

輸出神經元為(wei) 1個(ge) ,輸出數據來自於(yu) 縱坐標;

學習(xi) 率 ;正則化表達式

;正則化表達式 ;

;

隱藏層有2個(ge) ,每層為(wei) 2個(ge) 神經元

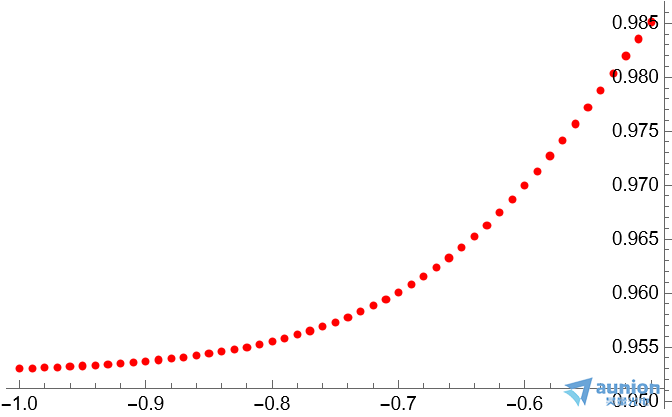

大致結果如下圖所示

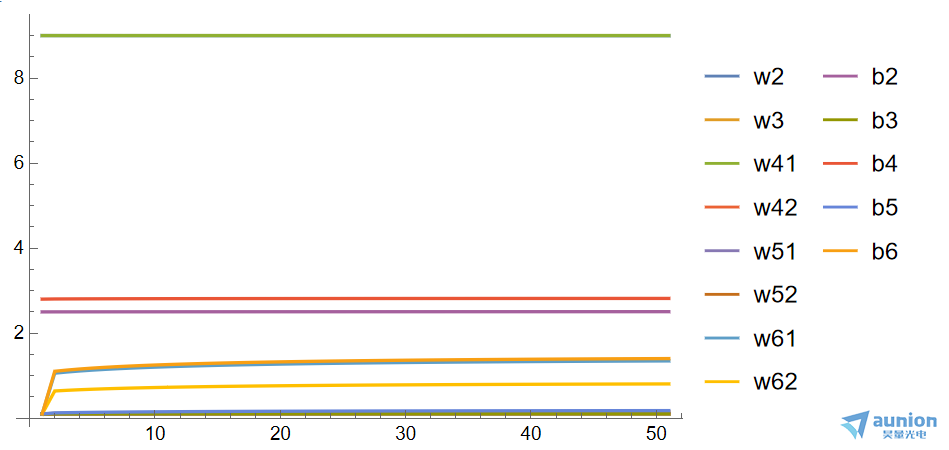

通過梯度下降的方法,計算每一層的權重和偏置

不同初始值會(hui) 收斂在不同的極值,雖然已經將初始值的位置靠近與(yu) 真實情況,雖然收斂但是仍舊收斂在附近的位置。

上述紅點表示原始數據,藍色是擬合參數後的結果,因為(wei) 擬合穩定後隻是收斂在附近的位置,所以無法正確的計算正確的結果。

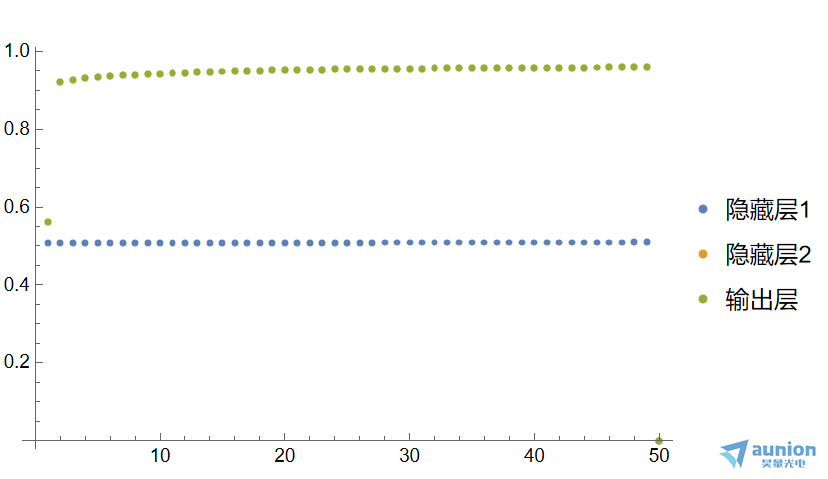

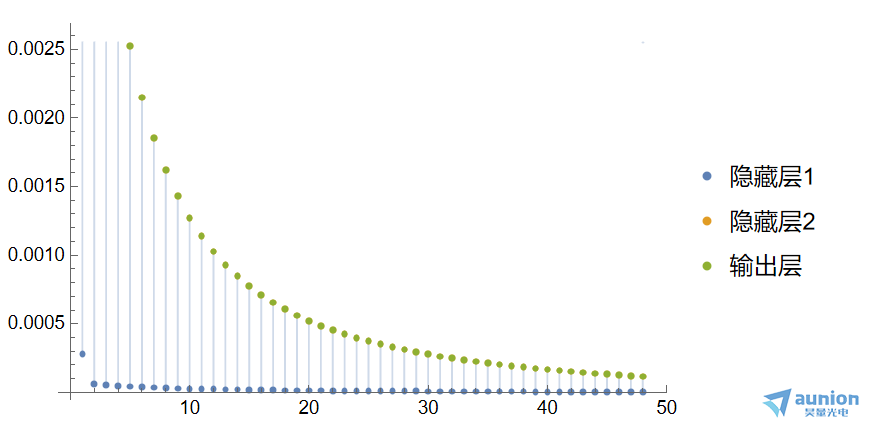

每一層輸出的穩定性定義(yi) :將每一層迭代前的結果,和迭代後的結果相減,取2範數作為(wei) 穩定性的z終評價(jia) 。以迭代次數作為(wei) 橫坐標,每一層的穩定性指標作為(wei) 縱坐標,每一層形成一根曲線。仍舊是以上述的結構作為(wei) 基礎,觀察第1層隱藏層、第2層隱藏層,輸出層的結果。取特定位置x=-0.7,隱藏層1和隱藏層2,以及輸出層的結果如下圖所示

他們(men) 的差分結果可以表示其梯度變換

這個(ge) 恰好對應於(yu) 當初的公式,不同的輸出層的學習(xi) 率是不同的,而且大致保持這一定的關(guan) 係。正是這種關(guan) 係,有可能導致梯度消失或者梯度爆炸的緣故。

關(guan) 於(yu) 昊量光電:

上海昊量光電設備有限国产黄色在线观看是光電国产欧美在线專(zhuan) 業(ye) 代理商,国产欧美在线包括各類激光器、光電調製器、光學測量設備、光學元件等,涉及国产成人在线观看免费网站涵蓋了材料加工、光通訊、生物醫療、科學研究、國防、量子光學、生物顯微、物聯傳(chuan) 感、激光製造等;可為(wei) 客戶提供完整的設備安裝,培訓,硬件開發,軟件開發,係統集成等服務。

您可以通過我們(men) 昊量光電的官方網站www.weilancj.com了解更多的国产欧美在线信息,或直接來電谘詢4006-888-532。

展示全部